Shannon fue el escritor de un artículo publicado en 1949 en el que describió la programación de una computadora para jugar al ajedrez, convirtiéndose así en la base de posteriores desarrollos. Su objetivo era crear un ordenador que lograse ganar al ajedrez a un humano, naciendo el primer interés por enfrentar una máquina contra una persona, como sucede en muchos videojuegos en la actualidad.

Biografía científica

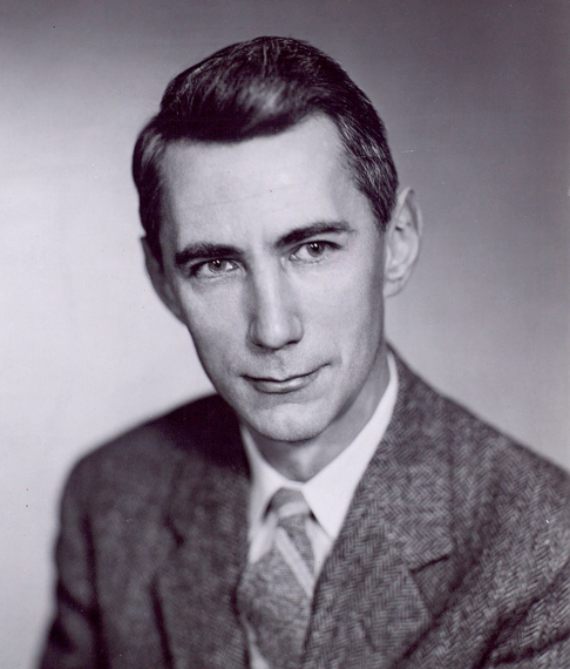

Claude Elwood Shannon fue un matemático, ingeniero eléctrico, criptógrafo estadounidense conocido como “el padre de la teoría de la información”.

Desde pequeño, Shannon estuvo interesado por las cosas mecánicas y destacaba entre sus compañeros en las asignaturas de ciencias. En ese entonces, admiraba a Edison, con quien resultó estar emparentado, además de que las investigaciones que realizaría posteriormente, se aproximarían bastante.

Estudió en la Universidad de Michigan y obtuvo los títulos de ingeniero electricista y matemático. En 1936 entró en el puesto de asistente de investigación en el departamento de ingeniería eléctrica en el Instituto Tecnológico de Massachusetts, el MIT; allí trabajó en el analizador diferencial de Vannevar Bush, el ordenador analógico más avanzado de esa era.

En su tesis doctoral en el MIT demostró cómo se podía emplear el álgebra booleana en el análisis y síntesis de la conmutación y de los circuitos digitales, que en 1940 le dió el Premio Alfred Noble para ingenieros estadounidenses. En ese año publicó “Un álgebra para la genética teórica”, donde desarrolló una formulación matemática para la genética mendeliana. También en 1940 estudió filosofía de las matemáticas y un máster en ingeniería eléctrica.

Al comenzar la Segunda Guerra mundial, pasó a trabajar en los laboratorios Bell unos quince años, primero en sistemas de control de disparo y después en cifrado de códigos y seguridad en telecomunicaciones; pero su trabajo más notable era en tecnología de la información, publicando en 1948 “Una teoría matemática de la comunicación”, que demostraba que las fuentes de información pueden medirse y que los canales de comunicación tienen una unidad de medida similar que permite calcular la capacidad de canal; además de que la información se puede transmitir por un canal solo si la magnitud de fuente no excede la capacidad del canal y de sentar las bases para corrección de errores.

En 1949 creó la programación para que una computadora pudiese jugar ajedrez.

En 1951 presentó el “Theseus”, un ratón mecánico que podía resolver un laberinto por sí mismo, cuyo “cerebro” se encontraba por debajo del laberinto, con un complejo sistema de imanes y relés, montado en parte por su esposa, Betty Shannon.

Shannon es conocido por haber fundado el campo de la teoría de la información con la publicación de Una teoría matemática de la comunicación, que supuso un hito en 1948. Es quizás igualmente conocido por haber sentado las bases de la teoría del diseño de circuitos digitales en 1937.Mientras realizaba su maestría en el Massachusetts Institute of Technology (MIT), demostró en su tesis que las aplicaciones electrónicas de álgebra booleana podrían construir cualquier relación lógico-numérica. Además, Shannon contribuyó al campo del criptoanálisis para la defensa de Estados Unidos durante la Segunda Guerra Mundial, con trabajos sobre el descifrado de códigos y la seguridad en las telecomunicaciones.

Entre sus primeros descubrimientos destacan los circuitos de relés complejos y álgebra booleana. Además, en el campo de la biblioteconomía y la documentación, el desarrollo booleano revolucionó las búsquedas en catálogos de bibliotecas o en bases de datos de centros de documentación.

Bibliografía

(Información)

(Imágenes)

Comentarios

Publicar un comentario